Un jour en consultant votre trafic, vous constatez une dégringolade de la fréquentation de votre site web. Dans ce cas, ne paniquez pas ! Les causes d’une chute de visibilité peuvent être multiples. Il est donc important d’identifier la ou les raisons de ce changement pour ensuite mettre en place des actions correctrices pertinentes.

Dans cet article nous allons passer en revue les critères les plus courants qui peuvent expliquer une baisse de trafic en référencement naturel.

Une baisse générale du trafic et pas uniquement en SEO

La première chose à faire est d’identifier les canaux d’acquisition impactés par cette baisse dans Google Analytics ou un autre outil de suivi de trafic.

Si la chute concerne l’ensemble des canaux, elle n’est pas forcement liée au référencement naturel et à une perte de positionnement sur les moteurs de recherche. Elle doit donc être expliquée par une autre raison. Dans ce cas, voici plusieurs hypothèses qu’il vous faudra étudier et vérifier.

Une panne ou un piratage ?

Votre site ou une partie de celui-ci n’est peut-être tout simplement plus disponible aux internautes. Une panne du serveur, une mise à jour défectueuse ou un piratage peuvent par exemple rendre indisponibles vos pages web. Une consultation du site vous permettra de vous rendre compte s’il est correctement accessible.

Si votre site a été piraté, Google peut aussi afficher un message dans les résultats de recherche et dans la rubrique « Problème de sécurité » de la Search Console : « il est possible que ce site ait été piraté ». Pour rester pro-actif face au risque de piratage, une solution est de créer des alertes permettant de détecter des contenus pirates sur votre site. Pour cela, rendez-vous sur Google Alerts et renseignez la requête suivante : site :www.mondomaine.com + casino ou des mots-clés adultes afin de recevoir un mail dans le cas où du contenu remonte sur cette requête.

Une baisse d’intérêt ou la saisonnalité ?

On s’intéresse plus aux sports d’hiver en février qu’en avril tout comme on recherche plus souvent des solutions contre les allergies à l’arrivée du printemps.

Pour de très nombreux secteurs, ces tendances de saisonnalité se reflètent dans l’évolution du trafic des sites web. Une baisse de fréquentation peut donc s’expliquer par une période de l’année moins propice à votre activité. Une comparaison avec le trafic des années précédentes permettra d’analyser les mois où le sujet que vous traitez est le plus recherché.

D'une manière générale, lorsqu'on souhaite mesurer l'évolution du trafic sur son site, il est nécessaire de comparer le trafic par rapport au même mois l'année précédente plutôt qu'avec le mois précédent. Par exemple, pour vérifier l'évolution du trafic d'un site au mois d'avril 2017, on comparera les métriques avec avril 2016 et non pas avec mars 2017.

Votre site peut aussi être référencé sur des requêtes de moins en moins recherchées pour d’autres raisons. Par exemple, si vous êtes dans le domaine du sport, la fin d’une compétition peut avoir un impact négatif sur le trafic SEO de votre site.

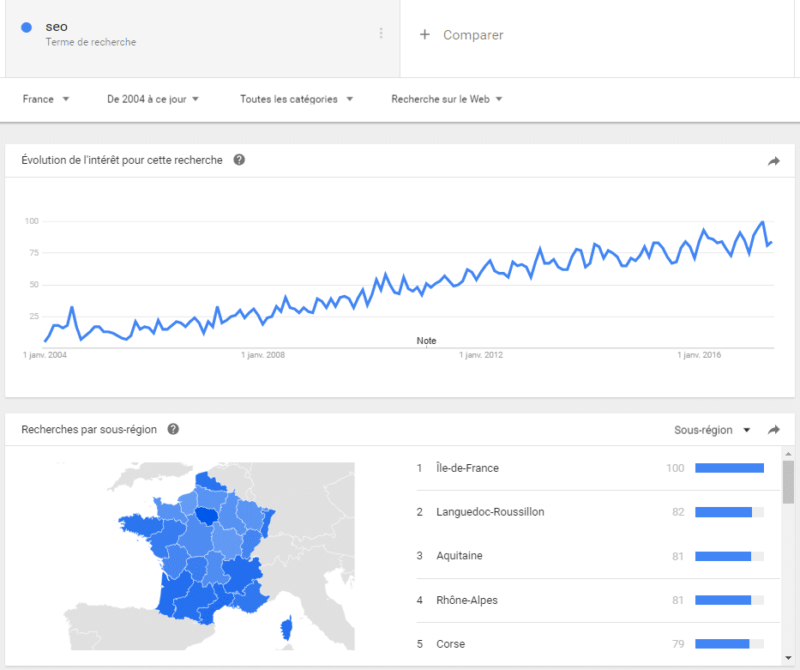

Observez la saisonnalité du trafic avec Google Trends

L’outil Google Trends aidera à identifier si l’intérêt pour votre secteur sur les moteurs de recherche tend à la baisse.

On y rentre la requête que l'on veut analyser et plusieurs informations basées sur les recherches faites sur le moteur Google nous sont renvoyées. La principale donnée est l'évolution de la tendance de recherche sur une base 100. C'est à dire que la période où la requête a été le plus tapée est à 100 et toutes les autres périodes donnent une valeur pondérée. Si le mois d'après, la requête a été deux fois moins tapée, l'information renvoyée sera "50".

On ne parle donc pas de valeur absolue mais bien de tendances, qui permettent de mesurer une évolution. Une requête passant de 10 000 saisies mensuelles à 5 000 sera présentée de la même manière qu'une requête passant de 20 à 10 recherches.

L'outil propose des options complémentaires :

- Comparaison de plusieurs tendances

- Choix des territoires observés

- Tendance en fonction des pays / région / villes

- Requêtes similaires

Un mauvais paramétrage de Google Analytics

Et si ce n’était pas le site qui était défaillant mais l’outil de suivi de trafic ? Un problème de configuration de Google Analytics (ou autre outil de suivi de suivi de fréquentation) peut laisser croire à une chute de visibilité.

Vérifiez le bon paramétrage de votre outil en suivant sa documentation. Pour Analytics c’est par ici que ça se passe.

Vous pouvez notamment vérifier cette checklist des problèmes de configuration courants :

- Code de suivi manquant : vérifiez si le code de suivi est bien présent dans le code source de toutes les pages du site;

- Mauvais code de suivi : en cas de récupération du thème d'un autre site ou d'une erreur de manipulation, il peut arriver d'intégrer un code de suivi appartenant à un autre site;

- Spam analytics retiré : le spam analytics est une technique gênante qui consiste à faire remonter dans Google Analytics de fausses informations de visites dans le but de faire connaitre des services tiers. Des démarches sont donc souvent mises en place pour l'éliminer des outils de suivi. Si votre site enregistrait une part importante de trafic provenant de spam, le nettoyage de ces données peut causer une chute du trafic enregistré;

- Des filtres mal configurés : surveillez également les filtres qui ont été mis en place afin de vous assurer qu'aucune erreur n'a été paramétrée. Par exemple, en inversant inclure et exclure pour éliminer votre adresse IP des données suivies, vous risquez d'ignorer une grande partie du trafic réel;

Des outils peuvent vous aider à vérifier le bon paramétrage de Google Analytics. C'est par exemple le cas de GA Checker, un tool web gratuit qui parcourra l'ensemble des pages de votre site et vérifiera pour chacune le marquage Google Analytics.

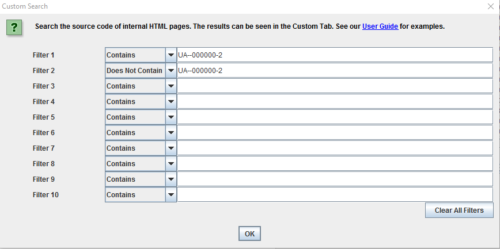

De même, le crawler Screaming Frog permet de vérifier si le code de suivi est bien intégré. Pour cela, avant de lancer un scan du site, il faut se rendre dans le menu suivant : Configuration > Custom > Search et intégrer deux filtres en renseignant pour chaque le code de suivi Analytics. Un filtre sera configuré sur "contain" et un autre sur "does not contain".

Baisse de trafic : les causes liées au référencement naturel

Une chute de trafic peut aussi être expliquée par une baisse de visibilité sur les moteurs de recherche. Si vous constatez dans votre outil de suivi que la baisse concerne principalement le canal "organique", il peut-être intéressant d'analyser les données renvoyées par un outil de suivi du positionnement tel que Ranks, MyPoseo, Semrush ou Seobserver.

Utilisation d'un outil de suivi des positions

Un tel outil vous permettra de confirmer si une baisse du trafic est bien causée par une perte de visibilité dans les moteurs de recherche en observant les chutes de positions. De plus, en fonction des mots-clés sur lesquels votre site est impacté, vous serez en mesure d'identifier si la chute de fréquentation est liée à une baisse globale ou seulement sur certains mots-clés. Cette analyse est primordiale pour bien orienter les hypothèses qui seront étudiées par la suite et évaluer l'ampleur des correctifs à apporter.

Si la perte de visibilité est modérée (un passage de la 1ère à la 2nd page par exemple), du travail sur le netlinking et le contenu suffira probablement à rétablir la visibilité initiale du site.

Si la chute est rapide ou concerne l'ensemble des mots-clés, le problème nécessitera une analyse plus rigoureuse. Pour cela, nous vous invitons à étudier les points suivants :

Un problème qui empêche le crawl ou l’indexation des contenus ?

Une forte baisse du trafic SEO peut révéler un problème d'affichage du site dans les pages de résultats. Il vous faudra alors vérifier si votre site n’est pas touché par un blocage technique en raison d’un mauvais paramétrage.

Ce problème peut se manifester d’une part au niveau du crawl des pages : les contenus de votre site sont-ils bien accessibles aux robots des moteurs de recherche ? Ou bien au niveau de l’indexation : Googlebot et les autres robots sont-ils autorisés à ajouter à l’index du moteur de recherche les contenus de votre site ?

Pour contrôler cela, plusieurs outils sont à votre disposition.

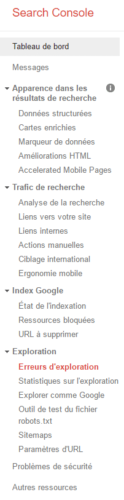

Analyse d’une baisse de trafic SEO à l’aide de la Search Console

Dans cet outil proposé par Google, voici des éléments qui peuvent être analysés pour identifier et comprendre une baisse de visibilité en référencement naturel :

- Vérifiez s’il existe des problèmes de paramétrage du fichier robots.txt grâce à l’outil de test dans le menu « exploration ».

- Les différents outils dans « Index Google » permettent d’identifier des problèmes d’indexation afin de les corriger.

- « Etat de l’indexation » offre une vue d’ensemble de la présence du site dans l’index et d’éventuelles chutes d’indexation ;

- « Ressources bloquées » rend compte des pages interdites à l’indexation (par le fichier robots.txt par exemple). A noter que ces pages peuvent tout de même remonter dans les résultats mais de façon incomplète, notamment si elles avaient déjà été indexées avant l'interdiction de robots.txt. Par exemple, dans les pages de résultats, la meta description peut-être remplacée par le texte "La description de ce résultat n'est pas accessible à cause du fichier robots.txt de ce site." Cela peut avoir un impact sur le taux de clic.;

- « URL à supprimer » vous permettra de vérifier si vous n’avez pas demandé par erreur la suppression de pages de l’index.

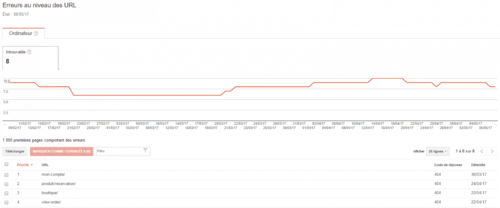

- Repérez et réglez les problèmes de crawl de votre site remontés dans « Erreurs d’exploration » (erreurs 404 ou erreurs serveur).

- Consultez vos pages les plus importantes ou celles ayant subi les plus fortes baisses à l’aide d’« explorer comme Google » pour identifier d’éventuels problèmes de visibilité de votre contenu par les robots.

- Assurez-vous que la version mobile de votre site est bien accessible aux robots. Cela est d’autant plus important que ce format du site servira de base d’exploration à Google dans les mois à venir. L’onglet « ergonomie mobile » de la Search Console pourra notamment vous indiquer d’éventuelles erreurs.

- Vérifiez que le sitemap de votre site est bien renseigné et configuré. Comparez également le nombre d'URL soumises dans votre sitemap avec le nombre d'url indexées ainsi qu'avec le nombre de résultats renvoyés par une recherche sur Google site:mondomaine.com. Si les nombres divergent, vous avez probablement des pages qui ne présentent pas assez d'intérêt aux yeux des moteurs de recherche pour être indexées.

- Une mauvaise configuration des paramètres d'URL peut aussi causer la disparition de pages dans le moteur de recherche. Les paramètres d'URL sont des informations que l'on retrouve dans certaines adresses de sites dynamiques. Par exemple, un filtre par taille sur un site de vente de vêtement.

- Enfin, une vérification de l'onglet "données structurées peut mettre en évidence des erreurs d'implémentation du balisage schema.org, ce qui peut causer des problèmes d'indexation.

Identification de problèmes avec un crawler

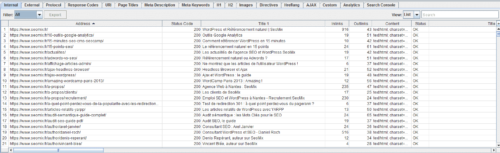

Vous pouvez faire appel à un crawler tel que ScreamingFrog ou Xenu qui vous indiquera d’éventuels problèmes d’accès aux contenus (404, problèmes de redirection).

Ces outils vous permettront notamment d’identifier si des directives empêchent le référencement de certaines pages :

- Vérifiez la présence de balises meta no-index ou de paramètres X-Robot-tag dans les entêtes http qui peuvent interdire l’indexation des contenus concernés.

- Détectez également s’il existe des balises canonical mal renseignées (une canonical renvoyant vers des URL en 404 par exemple).

Mise à jour du site ou de ses contenus ?

Un autre facteur permettant d'expliquer une baisse du trafic en référencement est si le site a subit une mise à jour, sur le plan technique ou des contenus. En effet, l'évolution d’une partie du site, qu’il s’agisse du changement de version du CMS, de PHP, d’un plugin, l'ajout d’une fonctionnalité ou le passage au https par exemple, peut avoir des incidences sur le référencement du site.

Une mise à jour non maîtrisée ou précipitée peut affaiblir une stratégie SEO en générant plusieurs problèmes :

- Augmentation du temps de chargement ;

- Rendre des contenus inaccessibles, aux internautes ou aux robots ;

- Générer des contenus dupliqués ou des pages inutiles (en générant des pages vides) qui pénaliseront le crawl du site et donc son référencement ;

Certains types de mises à jour doivent notamment être accompagnés d’actions pour garantir les positions du site. Par exemple le passage d’un site en https nécessite de mettre en place des redirections qui permettent notamment de bien transmettre la popularité générée par les backlinks aux nouvelles URL. Cette mise à jour nécessite également de modifier la configuration de la Search Console et de Google Analytics.

Une chute de trafic suite à une mise à jour doit vous alerter. Il est souhaitable de vérifier si celle-ci a pu pénaliser le référencement du site.

Une modification des contenus peut avoir un impact sur les positions du site. Si après avoir modifié des textes, des liens internes ou supprimé des pages, vous constatez une baisse de la fréquentation, il faudra analyser ces changements et envisager de revenir en arrière.

Perte d’un ou plusieurs liens importants ?

Le SEO repose en grande partie sur le critère de popularité. Autrement dit le netlinking. Ainsi, si les liens externes améliorent le référencement d’un site, leur perte peut causer des chutes de positions.

Face à une baisse du trafic organique, après avoir vérifié la bonne indexation du site et d’éventuelles mises à jour il faut également regarder du côté du profil de liens grâce à des outils tels que Majestic SEO afin de vérifier si un ou plusieurs liens externes de qualité n’ont pas été retirés sur des sites tiers.

Si cela est confirmé, la solution est de contacter le webmaster du site concerné pour lui demander de rétablir le lien.

Impacté par du negative SEO ?

A l'inverse de la perte d'un lien, votre site pourrait aussi être impacté par une stratégie de negative SEO à son encontre.

Le plus souvent, il s'agit d'une technique qui consiste à générer de nombreux liens de mauvaise qualité vers le site d'un concurrent dans le but de pénaliser son profil de backlinks. Vous pouvez vérifier si vous êtes victime d'une telle attaque en consultant un outil de suivi des backlinks ou en étant alerté directement par Google comme nous le verront plus bas dans la partie "pénalité manuelle".

Si vous êtes victime d'une telle stratégie, il vous faudra probablement utiliser l'outil de désaveu de backlinks proposé par Google pour nettoyer votre profil de liens.

Le negative SEO peut aussi être réalisé en copiant les contenus de votre site comme nous allons le voir.

A noter que nous vous déconseillons de mettre en oeuvre ces pratiques qui posent des problèmes sur le plan moral et légal.

Un problème de duplication de contenus

Une autre pratique qui peut expliquer une chute de la visibilité est le contenu dupliqué externe. On parle ici des contenus de votre site qui seraient publiés sur d'autres sites. Si Google considère ces domaines comme ayant plus d'autorité pour une requête donnée, il pourra les afficher dans les résultats de recherche au détriment du vôtre.

Du contenu dupliqué peut apparaître dans le cas d'une manœuvre de négative SEO à votre encontre. Mais il ne faut pas tomber dans la paranoïa. Cela peut aussi être l'action d'une personne peu au fait des questions de droit d'auteur qui trouvait simplement votre contenu intéressant et souhaité le relayer. De plus, le contenu dupliqué externe peut également provenir de... vous-même. Par exemple dans le cas ou une copie de vos pages sur un site de développement sont indexées.

Dans la plupart des cas, contacter le webmaster du site plagieur pour lui demander de retirer le contenu réglera le problème. Si cela ne suffit pas, avant de contacter un avocat, Google propose un outil de demande de suppression de contenu.

Un changement dans le moteur de recherche

Si vous ne constatez aucune modification particulière, que ce soit on-site ou off-site, la raison peut être liée au déploiement d’un nouveau filtre algorithmique (Penguin ou Panda), à une mise à jour des classements ou à un changement des critères du moteur de recherche. Par exemple, en février 2017, l’interface Google Images a été mis à jour et le trafic enregistré depuis ce moteur a cessé d’apparaitre dans les outils de suivi du trafic. Pour de nombreux domaines d’activités, ce changement a provoqué une importante chute de la fréquentation.

Face à un tel cas, il faut faire évoluer la stratégie de visibilité du site pour l’adapter à ces changements. Dans le cas d’un filtre algorithmique, les sites de mauvaise qualité peuvent perdre des positions et donc du trafic SEO. Pour éviter cela, il est conseillé de respecter les bonnes pratiques préconisées par les moteurs de recherche. Une agence de référencement pourra vous conseiller dans la mise en place d’une stratégie SEO sur le long terme.

Une pénalité manuelle ?

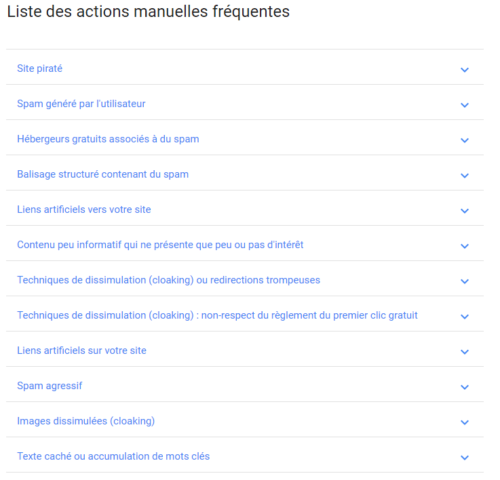

Enfin, une dégringolade de vos positions peut provenir d’une pénalité manuelle infligée par le moteur de recherche à votre site pour non-respect des bonnes pratiques. Pour vérifier si vous êtes affecté, consultez l’onglet « Actions manuelles » de la Search Console qui vous informera sur les éventuelles actions qui ont été prises à l’encontre de votre site ou d’une partie du site. Dans ce rapport, vous connaîtrez également le motif de la pénalité :

- Profil de lien fictif

- Suroptimisation de mots-clés (keywork stuffing)

- Contenus masqués

- Cloaking

- Contenu de mauvaise qualité

- Génération de spam

Ces informations vous permettront de réaliser des actions correctives pour ensuite demander un réexamen à Google.

Quelle partie du site impactée par la baisse ?

En vous engageant dans l'analyse d'une perte de trafic, il est essentiel d'identifier si la chute concerne l'ensemble du site ou seulement une partie de celui-ci. Pour cela, Google Analytics peut vous indiquer quelles sont les pages qui subissent la baisse. L'autre solution est d'étudier les mots-clés impactés par la chute. Si seulement une partie des mots-clés est touchée, il faudra vérifier si c'était des pages de la même partie du site qui se positionnaient.

Le réponse à cette question vous aidera à analyser les différentes hypothèses. Par exemple, une baisse généralisée peut concerner la perte d'un lien important, un problème de serveur ou de l'indexation. Une baisse localisée sera facilement expliquée si elle concerne une partie du site qui vient de faire l'objet de modifications. Mais cela peut-également être lié à une pénalité ou à un filtre touchant seulement un répertoire du site.

Cette analyse préalable permettra de gagner beaucoup de temps dans l'étude des différentes causes de baisse de trafic SEO.

Conclusion

Si vous constatez sur votre site une baisse de trafic en référencement naturel, voici un plan d’action pour la traiter.

Tout d’abord, ne paniquez pas ! Il est essentiel de bien détecter la cause de cette baisse avant de mettre en place des actions correctrice. Agir trop vite fait courir le risque de partir sur des solutions inefficaces. Le risque est même d'entraîner un impact négatif en créant par exemple massivement de nouveaux liens alors que votre site subit une pénalité pour linking fictif.

Nous vous proposons tout d'abord de vous poser les questions suivantes.

- Est-ce que la baisse concerne que le trafic organique ou l’ensemble des canaux ? Dans le deuxième cas, il s’agit sans doute de la saisonnalité de l’activité, d’une panne ou d’un piratage ;

- Est-ce que votre site est victime d’un problème de lisibilité par les robots ou d’indexation ? Apparaît-il toujours dans les résultats de recherche ? Différents outils ont été présentés pour répondre à ces questions.

- Avez-vous effectué des mises à jour ou des changements de contenus sur votre site ?

- Votre profil de liens externes a-t-il évolué ?

- Google a-t-il fait l’objet d’une mise à jour algorithmique ou a-t-il infligé une pénalité à votre site ?

Ce passage en revue des causes possibles d’une perte de visibilité vous aidera à comprendre la raison de la baisse de trafic en référencement naturel de votre site. Une fois ce diagnostic terminé, vous serez en mesure de mettre en place des actions correctives pertinentes.

Vous avez besoin d'un accompagnement concernant une baisse de votre trafic SEO et pour améliorer la visibilité de votre site ? N'hésitez pas à nous contacter à ce sujet.

4 Commentaires

Bonne synthèse : ne pas oublier toutefois l'impact de la publicité. Si la concurrence se fait très présente via Adword et Shopping par exemple, on est beaucoup moins visible, voire invisible sur mobile en première page, et ce malgré de très bonnes positions.

Bonjour,

En plus, il peut y avoir la mise en place d'actions marketing, notamment SEA, qui peuvent cannibaliser le SEO également sur le search.

Bien à vous

Article très complet, qui souligne notamment l'importance de surveiller ses statistiques Google Analytics pour réagir rapidement et de manière adéquate.

Cet article sera certainement très utile à beaucoup dans les prochains mois, car des passages précipités vers le HTTPS risquent d'entraîner quelques revers SEO et donc des chutes de trafic...

Merci Louis ;)

Merci pour cet article très complet !

Laisser un commentaire